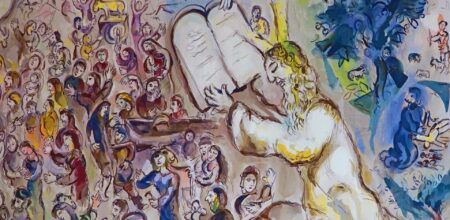

Il 10 gennaio 2023 tre rappresentanti delle tre religioni abramitiche hanno firmato, presso la Casina Pio IV in Vaticano, la Rome Call for AI Ethics. Si tratta di un documento nato per iniziativa della Pontificia Accademia per la Vita (Pav) per promuovere una «algoretica», ovvero uno sviluppo etico dell’intelligenza artificiale.

I partecipanti all’evento sono stati ricevuti in udienza da papa Francesco, il quale – ricordando l’enciclica Fratelli tutti – ha indicato la fraternità come «condizione perché anche lo sviluppo tecnologico sia al servizio della giustizia e della pace ovunque nel mondo». Il Pontefice ha anche mostrato con un esempio, che riguarda le domande dei richiedenti asilo, l’urgenza della riflessione e dell’attenzione politica: «Non è accettabile che la decisione sulla vita e il destino di un essere umano venga affidata ad un algoritmo».

La firma congiunta della #RomeCall for #AIEthics da parte di cattolici, ebrei e musulmani è un segno di speranza. Le religioni accompagnano l'umanità nello sviluppo di una tecnologia centrata sull'uomo grazie alla riflessione etica condivisa sull’uso degli algoritmi. #algoretica

— Papa Francesco (@Pontifex_it) January 10, 2023

Insieme al rabbino capo Eliezer Simha Weisz (membro del Consiglio del Gran Rabbinato di Israele) e allo sceicco Al Mahfoudh Bin Bayyah (Segretario Generale del Forum per la Pace di Abu Dhabi), ha firmato il documento anche il presidente della Pav, monsignor Vincenzo Paglia, il quale, in una intervista a Vatican News, aveva già anticipato che la Rome Call sarà siglata nel corso della prossima estate, in Giappone, anche dalle altre grandi religioni mondiali.

Cosa è la «Rome Call for AI Ethics»?

La Rome Call for AI Ethics è un documento firmato per la prima volta a Roma, il 28 febbraio 2020, dalla Pontificia Accademia per la Vita, Microsoft, Ibm, Fao e dal ministero dell’Innovazione, in rappresentanza del governo italiano. Il testo non costituisce né una dichiarazione congiunta, né un accordo, né un trattato. L’idea alla base è quella di promuovere un senso di responsabilità condivisa tra organizzazioni internazionali, governi, istituzioni e settore privato nel tentativo di creare un futuro in cui l’innovazione digitale e il progresso tecnologico garantiscano all’uomo la sua centralità.

Come ha spiegato in quell’occasione p. Carlo Casalone, il documento si sviluppa secondo tre grandi direttrici. La prima è quella etica, che richiama il quadro di valori fondamentali sotteso alla Dichiarazione universale dei diritti umani. La seconda direttrice mette in luce l’importanza dell’educazione per le giovani generazioni, che sarà segnata profondamente dalla disponibilità delle nuove risorse tecnologiche, a cui va garantito un accesso senza disuguaglianze. L’ultima direttrice è quella del diritto, in cui emerge l’esigenza di tradurre in regolamentazioni effettive i princìpi enunciati e di renderli incisivi attraverso un approccio etico che accompagni ogni passaggio del ciclo produttivo delle tecnologie, fin dall’inizio.

Il contesto: gli investimenti delle «big tech» e le questioni di responsabilità e diseguaglianza

Da tempo, i termini «metaverso», «algoritmi» e «blockchain» ritornano nelle occasioni e nei contesti più diversi. Il metaverso in particolare è stato negli ultimi anni oggetto di enormi somme investite dalle maggiori aziende del settore digitale – 70 miliardi di dollari (Microsoft); 10 miliardi (Facebook-Meta); 1,6 miliardi (Unity Software); 39,5 milioni (Google-Alphabet) – per mettere a punto la tecnologia che lo renderebbe possibile. Le questioni in gioco sono tantissime.

Per quanto riguarda l’intelligenza artificiale, due temi di grande preoccupazione, e che quindi configurano due sfide prioritarie anche per i firmatari della Rome Call, sono quello della responsabilità e quello della disuguaglianza. Che sono messi a fuoco in modo sintetico da questa affermazione di Virginia Eubanks, riportata in un articolo di p. Antonio Spadaro e Paul Twomey: «L’intelligenza artificiale ha la capacità di modellare le decisioni degli individui senza che questi nemmeno lo sappiano, dando a quanti hanno il controllo degli algoritmi un’abusiva posizione di potere».

Il nodo è il ruolo dell’essere umano all’interno dell’algoritmo: egli deve necessariamente essere ritenuto responsabile del prodotto a cui approda il processo decisionale algoritmico. Al netto delle rilevanti questioni di accessibilità, non è infatti sufficiente focalizzarsi solo sulla responsabilità e sull’educazione del fruitore finale per un impiego corretto dei sistemi digitali. Così come non basta affidarsi alla sensibilità morale di chi fa ricerca e progetta algoritmi.

Perché, concretamente, quello che succede è che alcune applicazioni di apprendimento profondo stanno cominciando a insidiare i confini della responsabilità umana. Dalle automobili a guida autonoma alle applicazioni di social scoring, a quelle di predizione della recidiva dei reati fino ai programmi che possono gestire sistemi di arma e interi apparati militari, la grande domanda è: possiamo davvero lasciare prendere decisioni da cui può dipendere la vita di una persona o di interi popoli a una intelligenza artificiale? E poi, in ogni caso, di chi sarà la responsabilità di quella decisione «intelligente»?

Ecco perché negli ultimi anni c’è stata una crescente richiesta, fatta ai governi da autorevoli tecnici e scienziati, dai sindacati, dalla società civile e dalle stesse aziende tecnologiche, di intervenire per garantire un controllo e la presenza dei valori umani nello sviluppo dell’AI.

Esiste, e sembra in una fase avanzata di approvazione, un progetto di Regolamento dell’Unione europea sull’intelligenza artificiale dell’aprile 2021. Al progetto ha dato un importante impulso l’allora presidente del Parlamento europeo, David Sassoli, scomparso l’11 gennaio del 2022. Proprio in occasione della sottoscrizione del Rome Call, Sassoli aveva affermato chiaramente che «abbiamo bisogno di regole che sappiano coniugare progresso tecnologico, sviluppo delle imprese e tutela dei lavoratori e delle persone, democrazia».

Il caso ChatGPT

In queste settimane si è parlato molto della prima grande applicazione di intelligenza artificiale disponibile per tutti sul web, ChatGPT, un nuovo modello di chatbot – una macchina che sa rispondere a domande poste da esseri umani – realizzata da OpenAI, fondazione che creata nel 2015 da investitori della Silicon Valley tra cui anche Elon Musk. ChatGPT è capace di comprendere il linguaggio umano e intrattenere conversazioni anche molto complesse. Si basa su campioni di testi presi da internet.

Anche noi abbiamo voluto mettere alla prova ChatGPT sul tema del discernimento e degli Esercizi spirituali di s. Ignazio. Nella nostra «conversazione», a un certo punto gli abbiamo chiesto se, prima di rispondere a una domanda, facesse un discernimento su cosa fosse meglio scrivere. Ci ha spiegato che «come modello di intelligenza artificiale, non ho la capacità di “decidere” o “discernere” cosa sia meglio scrivere. Invece, funziono seguendo un algoritmo di apprendimento automatico che mi consente di generare risposte alle domande basandomi sui dati su cui sono stato addestrato… Ma non ho una “coscienza” e non ho la capacità di valutare il bene e il male, non ho una vera intenzionalità nei miei output, ma solo un output elaborato attraverso un algoritmo». La sfida etica è tutta qui.